-

- 投稿日

- 2024.09.27

-

- 更新日

- 2024.09.27

生成AIを業務に導入することで、業務効率化などのメリットにつながります。

しかし、生成AIを導入しただけですぐに業務を効率化できるわけではありません。

生成AIは誤った情報を提案することもあるため、従業員による調整が必要です。

このような生成AIによる誤情報発信などのリスクを抑えられるのがRAGです。

RAGを活用することで、誤情報の抑制以外にも、ユーザーそれぞれに応じた対応ができるようになります。

本記事ではRAGの概要や求められる理由、メリット、導入の注意点などを解説します。

目次

RAG とは?

RAGとはRetrieval Augmented Generationの略で、日本語では検索拡張生成と訳される、生成AIの精度を向上させる仕組みです。

生成AIでは、実際の人と会話しているかのようにスムーズなやり取りができます。

これは生成AIの知能ともいえるLLM(大規模言語モデル)が、学習データをベースに適切な回答を選択するためです。

しかし、LLMは学習していないデータに含まれる質問に対しては回答することはできません。

例えば、公開されていないクローズドな情報についてはLLMは対応できません。

一方、RAGであれば企業の顧客情報などクローズドな情報を基にした出力が可能です。

そのためRAGを活用すると、従来の生成AIでは対応できなかった質問であっても回答できるようになります。

RAGが求められている理由

RAGが求められている理由は、生成AIで生じるハルシネーションを回避できるためです。

ハルシネーションとは、事実と異なる内容を回答として出力する現象のことを指します。

先述の通り、LLMはインターネットなどから収集した学習情報をベースに回答します。

そのため、学習していない情報に関する質問をされた場合、いかにも真実かのように誤情報を回答してしまう可能性があるのです。

このようなハルシネーション回避のために求められているのがRAGです。

RAGであれば信頼できるデータベースやソースを検索するため、ハルシネーションの発生を抑制できます。

生成AIがハルシネーションを発生させる理由

生成AIがハルシネーションを発生させてしまう理由は主に次の通りです。

- 学習した情報の量や質に問題がある

- 情報の正誤を判断できない

- 情報が古い

- プロンプトに問題がある

ここでは、生成AIがハルシネーションを発生させる理由を解説します。

学習した情報の量や質に問題がある

生成AIがハルシネーションを発生させてしまう理由として、学習した情報量や質に問題がある点が挙げられます。

例えば犬の画像だけや情報だけを学習させた生成AIに対して、猫のことを尋ねたとした場合、誤った情報を回答する場合があります。

情報の正誤を判断できない

生成AIがハルシネーションを起こす理由として、情報の正誤を判断できない点も挙げられます。

生成AIは学習した情報に誤りがあるのかを判断できません。

そのため、学習するデータに誤りや偏りがあった場合、そのまま学習して回答してしまうのです。

情報が古い

学習した情報が古いことも生成AIがハルシネーションを起こす理由の一つです。

例えば法律が改正されたにもかかわらず生成AIに学習させていないと、古い情報をそのまま回答しかねません。

プロンプトに問題がある

生成AIに対してユーザーが投げかけるプロンプト(指示)に問題がある場合も、ハルシネーションが発生することがあります。

プロンプトが曖昧になっている、もしくは誤っている場合、生成AIが誤った回答をする可能性があるでしょう。

RAGを導入するメリット

生成AIのハルシネーションを防止するために効果的なRAGは、導入することで次のようなメリットが期待できます。

- 生成AIの回答結果の精度を高められる

- パーソナライズした回答が可能になる

- スムーズな情報更新が可能になる

- 専門的な情報も回答できる

RAGを導入するメリットを一つひとつ解説します。

生成AIの回答結果の精度を高められる

RAGを導入することで、生成AIによる回答精度を高めることが可能です。

生成AIの場合、回答結果が誤っている可能性があるため、ファクトチェックの体制を整える必要があるでしょう。

一方、RAGを導入すれば自社の顧客情報など、信頼性の高い外部情報もベースにするため回答結果の精度を高められます。

しかし、RAGは精度の高い情報を集められるものの、オリジナリティのある回答を生み出すことが難しいという特徴があります。

そこでLLMを併用すると、文脈に配慮した上で独創的な回答が可能です。

このように、RAGとLLMを両方活用することで、多角的に回答を生成できます。

パーソナライズした回答が可能になる

LLMの場合、インターネットなどの情報をベースにするため、ユーザー一人ひとりに沿った回答は得意としていません。

一方、RAGであれば顧客情報や社内情報、専門分野の細かな情報などをベースとしているため、ユーザーそれぞれに沿うパーソナライズした回答が可能になります。

スムーズな情報更新が可能になる

スムーズな情報更新が可能になるのもRAGのメリットです。

一般的にLLMの場合、ファインチューニングと呼ばれる方法で定期的な情報更新が求められます。

ファインチューニングには専門的な知識が必要です。

対してRAGの場合、ベースである外部情報を更新することで、新しい情報であっても検索できます。

専門的な情報も回答できる

専門的な情報に回答できるのもRAGのメリットです。

LLMのみでは法律や金融など、専門的な分野について正確に回答できない可能性があります。

一方、RAGの場合、専門的な分野についての正確な情報を検索できるため、専門的な情報であって回答できます。

RAGの仕組み

RAGは、次の2つの段階を経てユーザーに回答を提案します。

- 検索段階

- 生成段階

検索段階

検索段階とはユーザーの質問に適した回答を外部情報から探し出している段階です。

RAGによる検索方法は大きく次の2つに分けられます。

| 検索方法 | 概要 | メリット | デメリット |

| ベクトル検索 | 単語の意味を把握して、関連情報を見つけ出す | 大規模な情報を高速に検索可能 | 開発コストがかさんでしまう |

| キーワード検索 | 単語や文字列のパターンを確認し、類似度に応じた情報を見つけ出す | ベクトル検索よりも費用を抑えて開発可能 | データ量が増えると生成速度が低下する |

ベクトル検索、キーワード検索ともにメリットとデメリットが存在します。

そのため、2つの短所を補うハイブリッド型が採用されるのが一般的です。

なお、単語や文章の意味(セマンティクス)を考慮して検索を行う、セマンティック検索と呼ばれる検索方法もあります。

セマンティック検索はキーワードの一致検索だけではなく、ユーザーがどのような意図で質問を入力しているかを判断して関連性の高い情報を提供可能です。

セマンティック検索を実現するためには、多くの場面でベクトル検索が使われています。

生成段階

外部情報から適切な回答を収集したら、LLMによってユーザーへの回答が生成されます。

RAGは情報を検索できるものの、LLMのように情報を要約してユーザーに分かりやすく伝えることはできません。

そのため、LLMが情報を要約し、分かりやすくユーザーに回答します。

RAGが活用される場面

RAGが活用される場面として以下が挙げられるでしょう。

- マーケティングや市場調査

- 研究機関における情報収集

- 顧客や社内の問い合わせ対応

ここではRAGが活用される場面を解説します。

マーケティングや市場調査

RAGはマーケティングや市場調査への活用が可能です。

市場調査の結果を外部情報として設定することで、競合の分析などが可能になります。

また市場のトレンドやニュースを外部情報として取り込むことで、トレンドを反映したECサイトやSNS運用を実現できます。

研究機関における情報収集

研究機関や大学などでの情報収集や分析にも、RAGは有効です。

例えば大規模な学術情報を検索できるRAGとLLMを組み合わせることで、研究にかかる時間の削減やコストの削減が期待できます。

顧客や社内の問い合わせ対応

チャットボットやバーチャルアシスタントとRAGとを統合させることで、顧客や社内の問い合わせ対応も可能です。

例えば顧客情報や製品情報を外部情報として設定することで、パーソナライズした顧客対応を実現できるでしょう。

RAGを活用する際の注意点

RAGを活用する際は次のような点に注意しましょう。

- 回答結果は外部情報に依存してしまう

- 機密情報の取扱いに注意する

- オリジナリティのある回答の生成は難しい

- 回答に時間がかかる可能性がある

回答結果は外部情報に依存してしまう

RAGによる回答結果は、外部情報に依存します。

例えば外部情報が誤っているのであれば、出力される情報も誤ってしまいます。

誤った回答結果の提示などを防止するために、回答結果のファクトをチェックする体制を整える、定期的に情報を更新するなどの対策を講じましょう。

機密情報の取扱いに注意する

RAGは機密情報の取扱いに注意しましょう。

RAGが参考にする外部情報に個人情報などの機密情報が含まれている場合、生成AIの回答に採用される可能性があります。

万が一の情報漏えいに備えて、機密情報は登録しない、アクセスの制限をするなどの工夫を凝らしましょう。

RAGが機密情報を検索して回答を生成してしまうと、企業の信頼を低下させかねません。

さらに企業の信頼低下、売上低下による業績悪化などにつながる恐れがあります。

オリジナリティのある回答の生成は難しい

先述のように、RAGは外部情報を検索するために、オリジナリティのある回答を生成することは難しいでしょう。

RAGは事実に基づいた正確な情報を提供します。

しかし、外部情報にはない回答は作成できません。

そのため、独自性のある回答を生成するのであれば、人間の創造性も上手に活用して、オリジナリティのある回答を実現させましょう。

回答に時間がかかる可能性がある

RAGを導入することで、LLMが回答を作成する前に情報検索の工程が発生します。

そのため、LLMだけを使用する際よりも回答に時間がかかる可能性があります。

回答に多くの時間がかかってしまう場合、ユーザーの満足度を低下させかねません。

回答に時間がかかってしまう際は、次のような対策を講じてみましょう。

- データの構造化と整理

- 検索・生成がスピーディなツールの導入

データの構造化とは、あらかじめ定められたデータを整形することです。

データの整形に加えて古いデータの整理などを講じることで、生成時間の短縮が期待できます。

また、文章が長いのであれば整理して分割することも有効です。

さらに検索・生成がスピーディなツールを導入しましょう。

例えば処理能力に長けているコンピューターで高性能のツールを使用することで、スピーディな回答につなげられます。

RAGを導入する際は体制を整えておく

RAGを導入する際は、適切に運用するための体制を整えておきましょう。

例えば、なぜRAGを導入するのか、導入することでどのようなメリットがあるのかを従業員に伝えて理解を得ることが大切です。

またプライバシーやセキュリティ、AIリテラシーについての従業員教育を行い、クオリティの高い情報収集・メンテナンス体制を確立しましょう。

RAGを活用して生成AIの利便性を高めよう

RAGはRetrieval Augmented Generationの略で、検索拡張生成と訳されています。

RAGと生成AIを統合させることで、生成AIのハルシネーション発生リスクを抑え回答精度を高められる、パーソナライズした回答が可能になる、専門的な情報も回答できるなどのメリットにつながります。

ただしRAGを活用する際は回答結果が外部情報に依存してしまうことや機密情報の取扱いに注意が必要なこと、回答に時間がかかる可能性があることなどの注意点を把握しておきましょう。

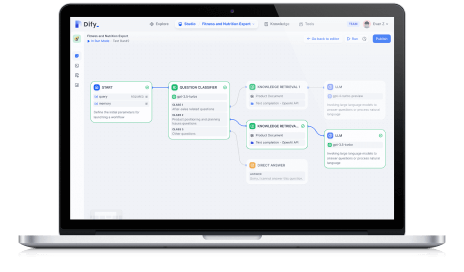

TDSEでは生成AIの導入をサポートしています。

業務や業種によって適した生成AIは異なるため、どのような生成AIを導入したら良いのか分からないとお悩みの方は、ぜひご相談ください。

LLM活用支援サービスはこちら

山本 豊

山本 豊Difyライセンス・支援サービスの営業責任者。

連絡先:dify@tdse.jp

お問い合わせはこちら

資料ダウンロードはこちら